Kodėl QA komandos turi vadovauti pamainai

Dirbtinis intelektas nebėra futuristinė koncepcija ar eksperimentinė galimybė. 2026 m. dirbtinis intelektas tvirtai įsitraukė į pagrindines verslo operacijas – priima sprendimus dėl samdymo, finansų, sveikatos priežiūros, klientų patirties ir kitų dalykų.

Šis pokytis atneša esminių pokyčių: DI rizika dabar yra verslo rizika.

Kokybės inžinerijos komandoms, ypač QA lyderiams, tai žymi lūžio tašką. Vaidmuo vystosi nuo funkcionalumo patvirtinimo iki užtikrinimo išmaniųjų sistemų pasitikėjimas, saugumas ir atitiktis.

Nuo eksperimentavimo iki vykdymo

Daugelį metų organizacijos kreipdavosi į AI su smalsumu – vykdydamos bandomuosius projektus, pateikdamos koncepcijos įrodymus ir pavienius naudojimo atvejus. Ta fazė baigėsi.

2026-ieji yra metai, kai AI reguliavimas aktyviai vykdomas tarp regionų. Tokios sistemos kaip ES AI įstatymas ir besikeičiantys pasauliniai atitikties standartai dabar reikalauja, kad organizacijos parodytų:

- Aiškios valdymo struktūros

- Rizikos vertinimo mechanizmai

- AI sprendimų auditas

- Nuolatinio stebėjimo sistemos

Jau nebeužtenka pasakyti „Mes naudojame dirbtinį intelektą atsakingai“.

Dabar organizacijos turi tai įrodyti – įrodymais.

AI valdymas dabar yra įmonės valdymas

Vienas didžiausių mąstymo pokyčių yra tai, kad dirbtinio intelekto valdymas negali egzistuoti atskirai.

Ji turi giliai integruotis su:

- Įmonės rizikos valdymas

- Kibernetinio saugumo sistemos

- Duomenų valdymo politika

- Pardavėjo ir trečiųjų šalių rizikos sistemos

AI sistemos sąveikauja su keliais įmonės architektūros sluoksniais, todėl valdymas a tarpfunkcinė atsakomybė.

QA komandoms tai reiškia glaudų bendradarbiavimą su:

- Apsaugos komandos

- Duomenų inžinierių komandos

- Atitikties ir teisės skyriai

Testavimas nebeapsiriboja programomis – dabar jis apima ištisos ekosistemos.

Supratimas apie naujus AI rizikos aspektus

Skirtingai nuo tradicinės programinės įrangos, AI kelia sudėtingą ir daugialypę riziką:

- Šališkumo ir sąžiningumo problemos → turi įtakos realaus pasaulio sprendimams

- Duomenų privatumo rizika → dėl didelio duomenų naudojimo

- Modelių netikslumai ir haliucinacijos → dėl to gaunami neteisingi išėjimai

- Reguliavimo neatitikimas → organizacijoms taikomos nuobaudos

Kiekvienai iš šių rizikų reikia skirtingų patvirtinimo strategijų.

Vien tradicinių bandomųjų atvejų neužtenka.

QA turi vystytis taip:

- Elgesio testavimas

- Etinis patvirtinimas

- Rizika pagrįsti testavimo metodai

Atitiktis dabar yra nuolatinė

Atitiktis AI eroje nėra vienkartinė sertifikavimo veikla – tai nuolatinis procesas.

Tikimasi, kad organizacijos įgyvendins:

- Nuolatinis AI sistemų stebėjimas

- Reguliarus rizikos vertinimas

- Gyvavimo ciklo valdymas nuo mokymo iki diegimo

- Anomalijų aptikimas realiuoju laiku

Tai įveda naują paradigmą:

„Atitiktis kaip nuolatinė inžinerinė praktika.

Kokybės užtikrinimo komandos turi unikalią padėtį, kad galėtų tai įgyvendinti pasitelkdamos automatizavimo, stebėjimo ir patvirtinimo vamzdynus.

Auditingumas ir Traceabyra privalomi

Vienas griežčiausių reikalavimų 2026 m patikrinamumas.

Organizacijos turi turėti galimybę atsakyti:

- Kodėl AI priėmė šį sprendimą?

- Kokie duomenys buvo naudojami?

- Kuri modelio versija buvo įdiegta?

- Kokios kontrolės priemonės buvo taikomos?

Tai reikalauja:

- Išsami dokumentacija

- Registravimo ir atsekamumo mechanizmai

- Skaidrus modelio elgesys

Kokybės užtikrinimo atveju tai reiškia ne tik rezultatų, bet ir rezultatų patvirtinimą sprendimų paaiškinamumas ir pėdsakų žurnalai.

Privatumas pagal dizainą nebėra neprivalomas

Privatumas dabar yra pagrindinis AI sistemų reikalavimas.

Jis turi būti įterptas skersai:

- Duomenų rinkimo vamzdynai

- Modelių mokymo procesai

- Diegimo architektūros

„Privatumas projektuojant“ užtikrina, kad sistemos atitiktų reikalavimus pagal nutylėjimąne kaip pasekmes.

QA komandos turi patvirtinti:

- Duomenų mažinimo praktika

- Sutikimo tvarkymas

- Duomenų maskavimas ir anonimiškumas

Suklydimo kaina

Blogo AI valdymo pasekmės nebėra teorinės.

Dabar organizacijos susiduria su:

- Reguliacinės nuobaudos

- Finansiniai nuostoliai

- Žala reputacijai

- Klientų pasitikėjimo praradimas

Dirbtinio intelekto sistemoms tampant savarankiškesnėms, rizika didėja greičiau, taigi ir poveikis.

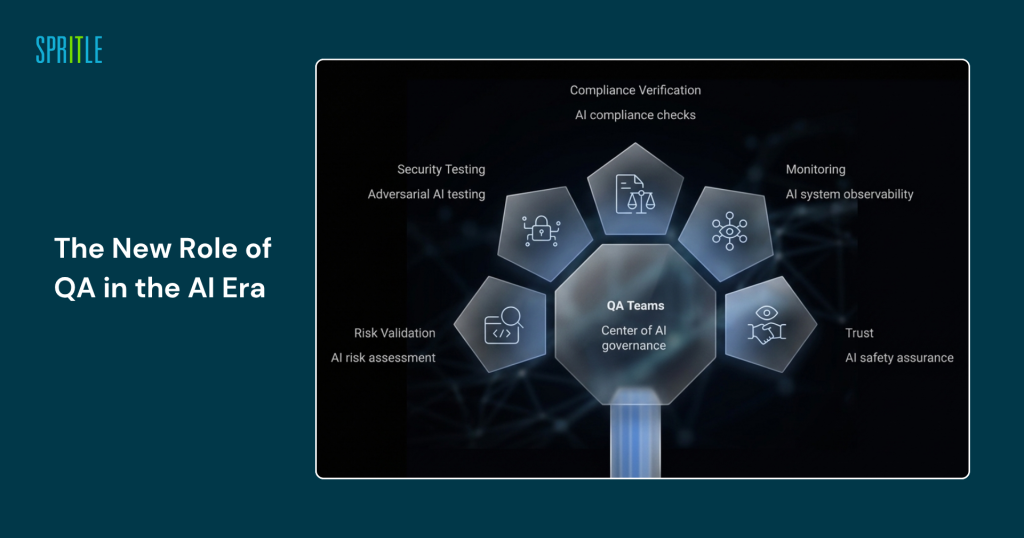

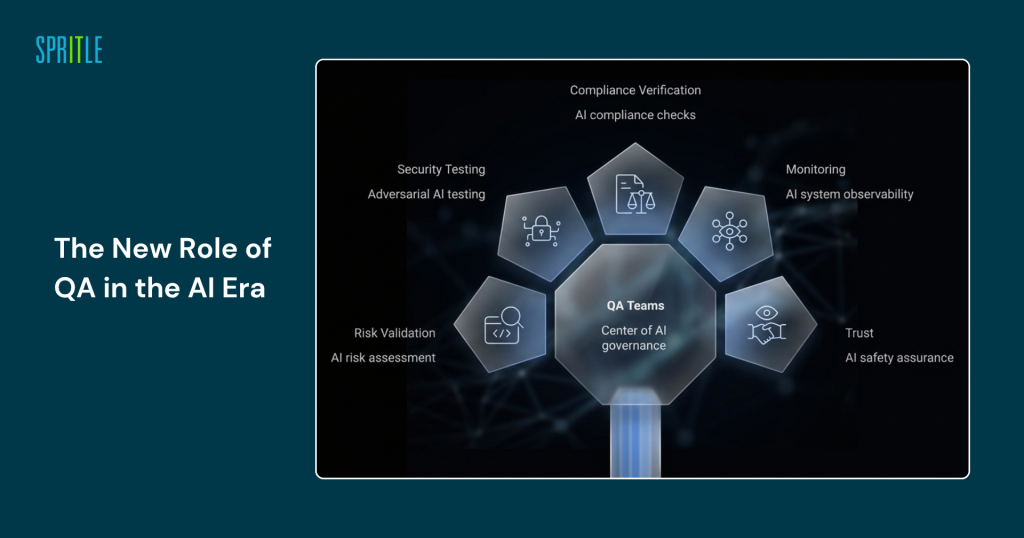

Naujas QA vaidmuo AI eroje

Dėl šios pertvarkos QA komandos yra DI valdymo centre.

Vaidmuo plečiamas ir apima:

- AI rizikos patvirtinimas

- Saugumas ir priešpriešinis bandymas

- Atitikties patikrinimas

- Stebėjimas ir stebėjimas

- Pasitikėjimas ir saugumo užtikrinimas

Iš esmės QA vystosi į a atsakingo AI globėjas.

Paskutinės mintys

2026 m. dirbtinis intelektas yra ne tik inovacijos – tai atskaitomybė.

Organizacijos, kurioms pasiseks, bus ne tos, kurios greičiausiai pritaikys dirbtinį intelektą, o tos, kurios jį priims saugiai, atsakingai ir skaidriai.

QA lyderiams tai yra galimybė peržengti tradicines ribas ir atlikti strateginį vaidmenį formuojant technologijų ateitį.

Kadangi AI amžiuje,

kokybė nebėra tik teisingumas – tai apie Pasitikėk.